- Hyperlink draait uitsluitend op lokale hardware, waardoor elke zoekopdracht privé blijft

- De app indexeert binnen enkele minuten enorme gegevensmappen op RTX-pc’s

- LLM-gevolgtrekking op Hyperlink verdubbelt in snelheid met de nieuwste optimalisatie van Nvidia

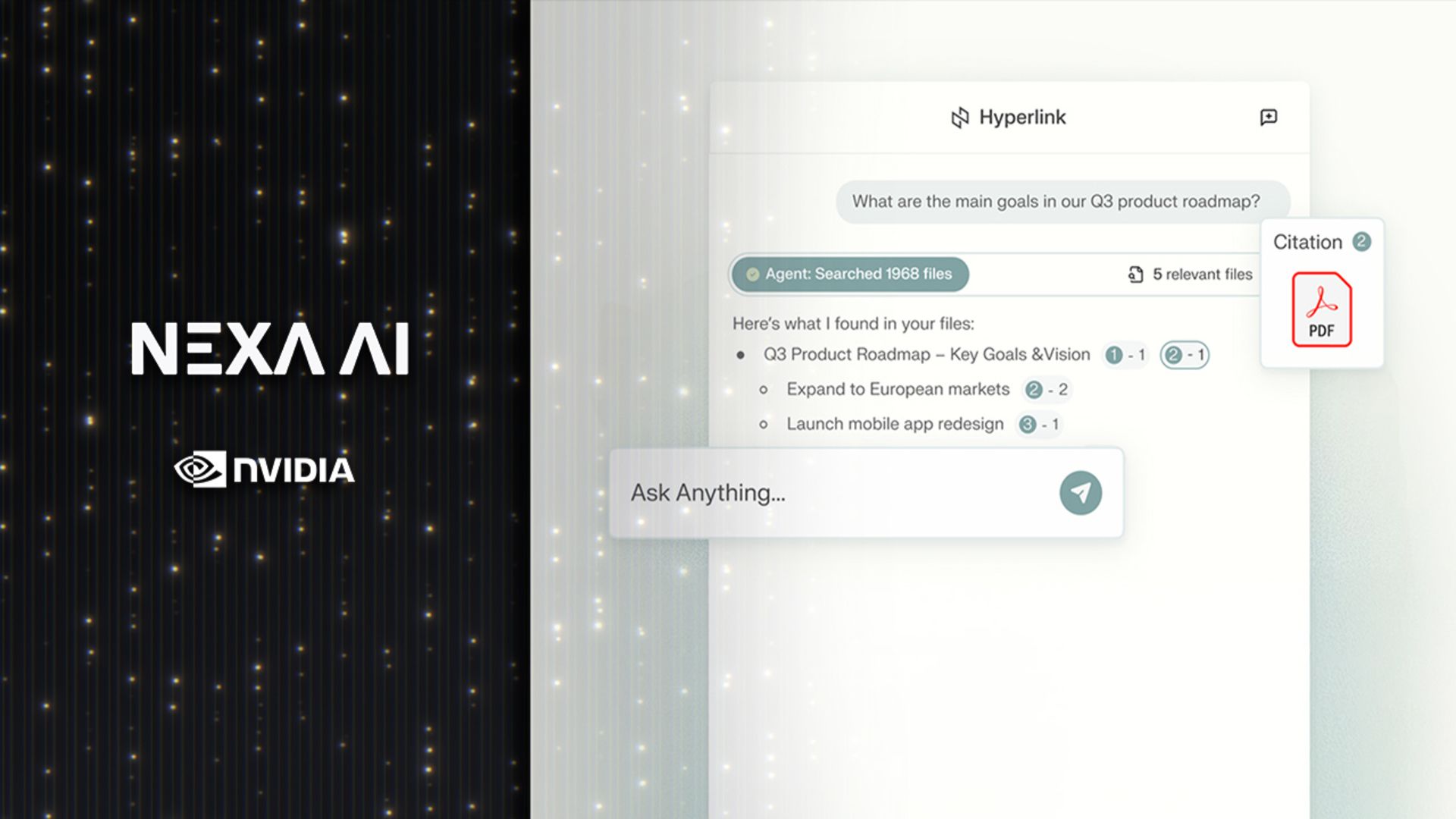

Nexa.ai’s nieuwe “Hyperlink” -agent introduceert een benadering van AI-zoekopdrachten die uitsluitend op lokale hardware draait.

Ontworpen voor Nvidia RTX AI-pc’s fungeert de app als een assistent op het apparaat die persoonlijke gegevens omzet in gestructureerde inzichten.

Nvidia geschetst hoe het, in plaats van verzoeken naar externe servers te sturen, alles lokaal verwerkt en zowel snelheid als privacy biedt.

Privé-inlichtingen op lokale snelheid

Hyperlink is gebenchmarkt op een RTX 5090-systeem, waar het naar verluidt tot 3x snellere indexering en 2x snellere indexering levert groot taalmodel gevolgtrekkingssnelheid vergeleken met eerdere builds.

Deze statistieken suggereren dat het duizenden bestanden op een computer efficiënter kan scannen en ordenen dan de meeste bestaande AI-tools.

Hyperlink matcht niet alleen zoektermen, maar interpreteert de bedoelingen van de gebruiker door de redeneermogelijkheden van LLM toe te passen op lokale bestanden, waardoor relevant materiaal kan worden gevonden, zelfs als bestandsnamen onduidelijk zijn of geen verband houden met de daadwerkelijke inhoud.

Deze verschuiving van statisch zoeken naar trefwoorden naar contextueel begrip sluit aan bij de toenemende integratie van generatieve AI in het dagelijks leven productiviteitsinstrumenten.

Het systeem kan ook gerelateerde ideeën uit meerdere documenten met elkaar verbinden en gestructureerde antwoorden bieden met duidelijke referenties.

In tegenstelling tot de meeste cloudgebaseerde assistenten slaat Hyperlink alle gebruikersgegevens op het apparaat op, zodat de bestanden die het scant, van pdf’s en dia’s tot afbeeldingen, privé blijven en ervoor zorgen dat er geen persoonlijke of vertrouwelijke informatie de computer verlaat.

Dit model spreekt professionals aan die gevoelige gegevens verwerken en toch de prestatievoordelen van generatieve AI willen.

Gebruikers krijgen toegang tot snelle contextuele reacties zonder het risico van gegevensblootstelling als gevolg van externe opslag of verwerking.

Nvidia’s optimalisatie voor RTX-hardware gaat verder dan de zoekprestaties, aangezien het bedrijf beweert dat Retrieval-Augmented Generation (RAG) nu dichte gegevensmappen tot drie keer sneller indexeert.

Een typische verzameling van 1 GB die ooit bijna 15 minuten duurde om te verwerken, kan nu in ongeveer 5 minuten worden geïndexeerd.

De verbetering van de sluitingssnelheid betekent ook dat antwoorden sneller verschijnen, waardoor dagelijkse taken zoals het voorbereiden van vergaderingen, studiesessies of rapportanalyse eenvoudiger worden.

Hyperlink combineert gemak met controle door lokaal redeneren en GPU-versnelling te combineren, waardoor het nuttig is AI-hulpmiddelen voor mensen die hun gegevens privé willen houden.

Volg TechRadar op Google Nieuws En voeg ons toe als voorkeursbron om ons deskundig nieuws, recensies en meningen in uw feeds te krijgen. Klik dan zeker op de knop Volgen!

En jij kunt dat natuurlijk ook Volg TechRadar op TikTok voor nieuws, recensies, video-unboxings en ontvang regelmatig updates van ons WhatsAppen Ook.