Informatie op hoog niveau over het privéwerk van studenten en medewerkers met behulp van ChatGPT Edu aan verschillende universiteiten kan worden gezien door duizenden collega’s binnen hun instellingen vanwege een misverstand over wat er wordt gedeeld, volgens een onderzoeker van de Universiteit van Oxford die het probleem heeft geïdentificeerd.

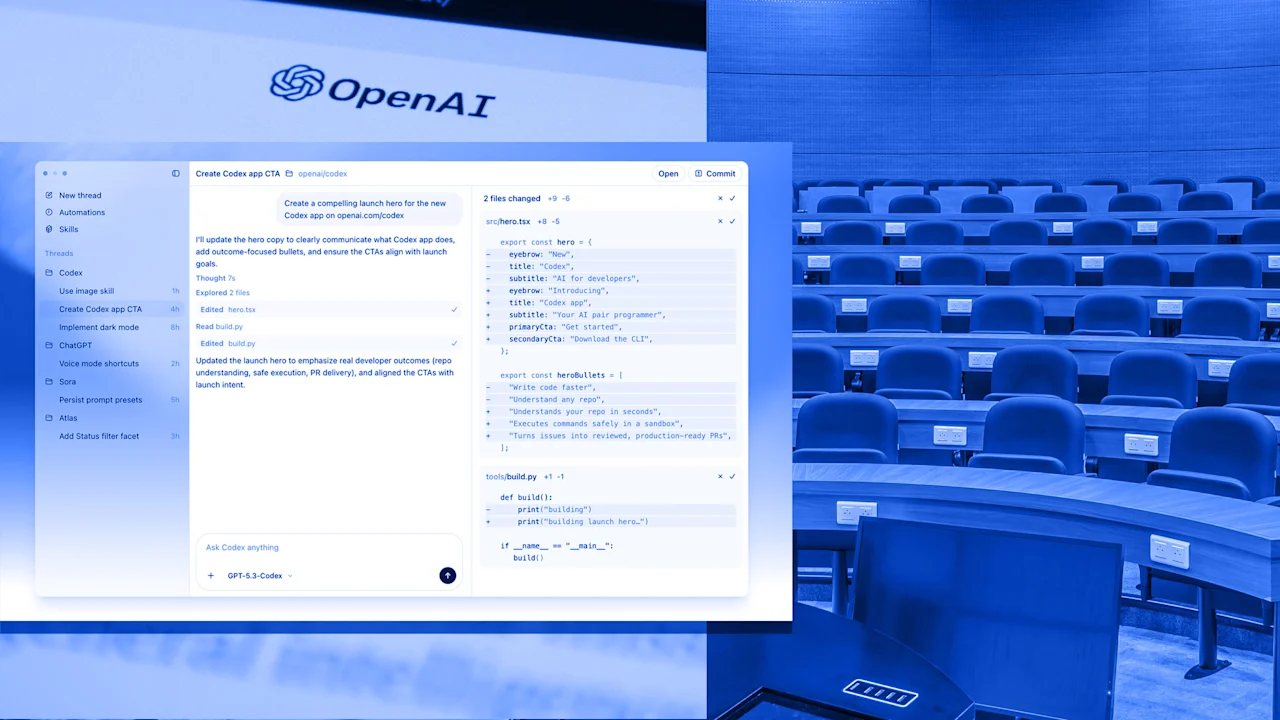

Het probleem treft Codex Cloud-omgevingen in ChatGPT Edu en onthult de namen en enkele metagegevens die zijn gekoppeld aan de openbare en privé GitHub-repository’s die gebruikers op een universiteit hebben verbonden met hun ChatGPT Edu-accounts.

Er zijn geen privécodes of opslaggegevens blootgesteld aan ongeautoriseerde gebruikers. Niettemin kunnen de zichtbare metadata nog steeds een betekenisvol beeld geven van de activiteit van gebruikers.

“Iedereen aan de universiteit, of in ieder geval een groot aantal mensen – inclusief ikzelf – kan een aantal projecten zien (waar mensen aan hebben gewerkt) met ChatGPT”, zegt Luc Rocher, universitair hoofddocent aan de Universiteit van Oxford, die het probleem heeft geïdentificeerd en het zowel bij de Universiteit van Oxford als bij OpenAI ter sprake heeft gebracht door middel van verantwoorde openbaarmaking. Hij kwam later dichterbij Snel bedrijf na wat hij voelde als een ontoereikende reactie van beiden.

Naast de projecten zei Rocher dat hij kon zien hoe vaak gebruikers interactie hadden met ChatGPT voor een bepaald project en wanneer die gesprekken begonnen. Uit deze metadata kon Rocher opmaken dat een student uit Oxford aan een artikel werkte om in te dienen met behulp van de tools van OpenAI – iets wat de student bevestigde toen Rocher hen benaderde.

“In termen van de omvang van de verschillende mensen die toegang hebben tot elkaars gedragsgegevens, is het behoorlijk zorgwekkend”, zegt een afzonderlijke onderzoeker van de Universiteit van Oxford, die sprak op voorwaarde van anonimiteit. Snel bedrijf om vrijuit over hun werkgever te praten. De onderzoeker erkent echter dat de gegevensblootstelling intern is en, hoewel breed, beperkt in diepte. “Ik vermoed dat dit de reden kan zijn dat het gegevensbeschermingsteam niet zo snel heeft gereageerd alsof het een publieke zaak was.”

De onderzoeker noemt het gebrek aan reactie van de instelling echter ‘naïef’. Ze voegen eraan toe: “Er zijn redenen waarom onderzoekers privérepository’s hebben.”

De situatie weerspiegelt een soortgelijk probleem eerder gemeld door Snel bedrijfwaar gebruikers van OpenAI’s standaard ChatGPT-product niet duidelijk werden geïnformeerd dat het delen van hun gesprekken ervoor kon zorgen dat die chats door zoekmachines konden worden geïndexeerd. Het bedrijf ontkende aanvankelijk het probleem de functie verwijderd na tegenreactie.

“Het lijkt mij dat het om een slechte standaard gaat”, zegt Rocher, waarbij gebruikers niet onmiddellijk en openlijk duidelijk wordt gemaakt wat ze kiezen.

Dit zegt een woordvoerder van OpenAI Snel bedrijf: “Gebruikers hebben volledige controle over hoe hun omgevingen worden gedeeld. Namen van repository’s kunnen alleen zichtbaar zijn voor andere leden van dezelfde organisatie als dit door de eigenaar van de werkruimte is gekozen, en de inhoud van de repository blijft veilig.”

De woordvoerder voegde hieraan toe: “We hebben rechtstreeks met de klant over dit probleem gesproken en zijn altijd blij met hun feedback.”

De Universiteit van Oxford weigerde commentaar te geven op de zaak. Snel bedrijf begrijpt dat Rocher andere universiteiten heeft geïdentificeerd – waaronder minstens één in het Midden-Oosten – die met hetzelfde probleem kampen.

“Ik denk dat dit iets is waar universiteiten zich bewust van moeten worden gemaakt”, zegt Rocher.

De situatie wijst op een bredere spanning over hoe AI producten worden geïmplementeerd, zeggen experts.

“Hoewel het niet duidelijk is hoeveel data standaard door OpenAI worden vrijgegeven, is het wel duidelijk dat de manier waarop deze systemen zijn geïntegreerd informatie zichtbaar maakt, zowel voor het bedrijf als voor de hele organisatie, die voorheen niet zichtbaar was”, zegt Michael Veale, hoogleraar technologierecht en beleid aan het University College London.

Veale zegt dat de dynamiek weerspiegelt hoe AI-systemen werken. “Het maakt deel uit van een bredere trend waarin AI-tools worden geïntegreerd zonder rekening te houden met de manieren waarop ze transformeren wie welke informatie kan zien, en de moeilijkheid, of zelfs onmogelijkheid, van gebruikers om te redeneren wat er achter de schermen gebeurt”, zegt hij. “Per definitie bevragen AI-systemen sneller externe diensten dan mensen.”

De discrepantie tussen AI-capaciteiten en menselijk toezicht brengt risico’s met zich mee.

“Mensen hebben al enorme moeite om op de beste momenten te begrijpen welke informatie er gebeurt”, zegt Veale. “Het sneller en alomtegenwoordiger maken zal het alleen maar moeilijker maken en de ondoorzichtigheid en kwetsbaarheid voor inbreuken en aanvallen in het proces vergroten.”