Bij een recente AI-top in New Delhi, Waarschuwde Sam Altman dat vroege versies van superintelligentie tegen 2028 zouden kunnen verschijnen AI kunnen worden ingezet om nieuwe ziekteverwekkers te creëren en dat democratische samenlevingen actie moeten ondernemen voordat ze worden ingehaald door de technologie die ze hebben gebouwd. Deze zorgen worden breed gedeeld binnen de sector. Geoffrey Hinton, de Nobelprijswinnaar die bekend staat als de ‘Godfather of AI’, heeft dat wel gedaan waarschuwde dat het creëren van digitale wezens die intelligenter zijn dan wijzelf een reële existentiële bedreiging vormt. Mustafa Suleyman, CEO van Microsoft AI, wijdde een groot deel van zijn boek aan dit onderwerp De komende golf op het argument waar AI mee samengaat synthetische biologie zou de middelen om een dodelijke pandemie te veroorzaken binnen het bereik van één enkel individu kunnen brengen. Dit zijn geen waarschuwingen voor de verre toekomst. Vorige week was er een botsing over wie AI controleert en onder welke voorwaarden leidde tot een volledige ineenstorting van het bedrijf relatie met het Pentagon.

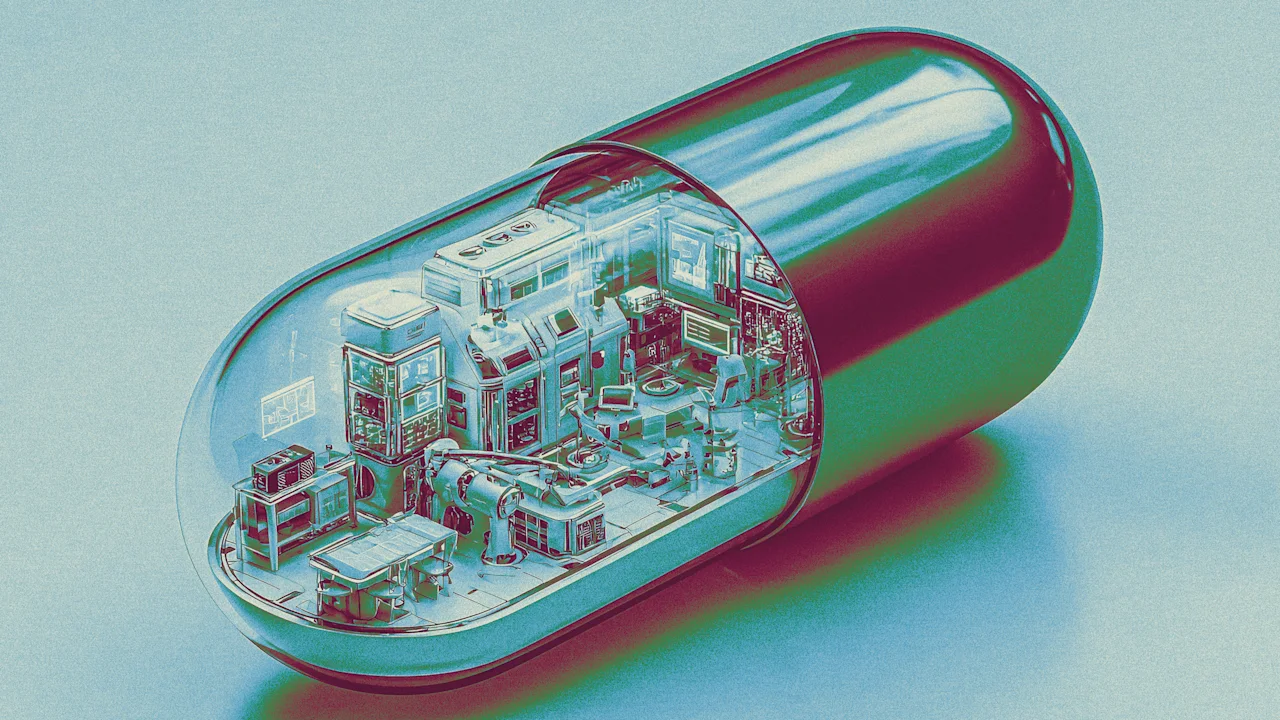

Wanneer politici en bedrijfsleiders dit soort kwesties proberen te begrijpen, komen ze vaak in de verleiding om naar de farmaceutische industrie te kijken voor een regelgevingsmodel. Senator Richard Blumenthal – een van de weinige wetgevers die actief aandringt op zinvolle AI-regulering –hebben voorgesteld dat de manier waarop de Amerikaanse overheid de farmaceutische industrie reguleert als model kan dienen voor AI-toezicht. De analogie is intuïtief logisch. Het farmaceutische model laat zien dat strikte licentieverlening en monitoring van potentieel gevaarlijke nieuwe technologieën bedreigingen kunnen beperken zonder onnodige beperkingen op te leggen aan innovatie.

De instinctieve aantrekkingskracht van deze aanpak beperkt zich niet tot wetgevers. Veel bedrijven passen dezelfde logica intern toe – al dan niet bewust – en beheren AI-risico’s door middel van fase-gate-beoordelingen, pre-implementatietests en monitoring na de lancering. Met andere woorden: het Pharma-model is al het de facto managementraamwerk voor grote delen van de industrie. Het probleem is dat dit het verkeerde raamwerk is – en de verschillen zijn niet alleen technisch, maar existentieel.

{“blockType”:mv-promo-block”,”data”:{“imageDesktopUrl”:https://images.fastcompany.com/image/upload/f_webp,q_auto,c_fit/wp-cms-2/2025/10/creator-faisalhoq ue.png”,”imageMobileUrl”https://images.fastcompany.com/image/upload/f_webp,q_auto,c_fit/wp-cms-2/2025/10/faisal-hoque.png”eyebrow” “klaar” om te gedijen op het kruispunt van zakenleven, technologie en menselijkheid? “,”dek “De boeken, podcasts en bedrijven van Faisal Hoque bieden leiders het raamwerk en de platforms om doelen, mensen, processen en technologie op één lijn te brengen – waardoor disruptie wordt omgezet in betekenisvolle, duurzame vooruitgang.” Meer”,”ctaUrl”:https://faisalhoque.com”, “theme”:{“bg”:#02263c”, “text”:#ffffff”,”eyebrow”#9aa2aa”, subhed”#ffffff”, “buttonBg”:#ffffff”, “b uttonHoverBg”:#3b3f46″, “buttonText”:#000000″},”imageDesktopId”:91420512,”imageMobileId”:91420514,”deelbaar”:false,”slug””,”wpCssClasses””}

Drie disanalogieën die er toe doen

Farmaceutische regulering werkt omdat de toetredingsdrempels hoog zijn, het product fysiek en controleerbaar is en de ontwikkelingscyclus langzaam genoeg is om toezicht te kunnen houden. Geen van deze voorwaarden is van toepassing op AI.

Ten eerste zijn de toetredingsdrempels heel verschillend. Het op de markt brengen van een nieuw medicijn kost gemiddeld 1,1 miljard dollar. volgens een onderzoek uit 2020 gepubliceerd in Tijdschrift van de American Medical Association. Alleen al de infrastructuur – laboratoria, netwerken van klinische proeven, productiefaciliteiten – beperkt de productie tot een relatief klein aantal identificeerbare bedrijven die toezichthouders kunnen monitoren. AI kent geen overeenkomstige wrijving. Compatibele modellen kunnen voor een fractie van die kosten worden gebouwd, afgestemd op consumentenhardware en wereldwijd worden ingezet vanaf een laptop. Het universum van actoren dat een toezichthouder moet volgen bestaat niet uit een handjevol identificeerbare bedrijven; het is potentieel iedereen, waar dan ook.

Ten tweede is een farmaceutisch product fysiek. Voor de productie ervan zijn grondstoffen, gespecialiseerde apparatuur en distributielogistiek nodig. Dit alles zorgt voor wrijving die toezichthouders kunnen uitbuiten door toezichtcontroleposten op te leggen. Maar code kent zo’n wrijving niet. Eenmaal vrijgegeven kunnen de gewichten van een AI-model nummer voor nummer worden gekopieerd en veel sneller over de grenzen heen worden gedeeld dan welk fysiek wapen of industrieel systeem dan ook. De marginale replicatiekosten zijn feitelijk nul. En software kun je je niet herinneren zoals je een besmet medicijn herinnert. Als het eenmaal in het wild is, blijft het in het wild.

Zelfs mogelijkheden die uitsluitend via toegang tot de cloud worden geleverd, zijn kwetsbaar voor replicatie en dus voor schendingen van bedrijfs- of regelgevingsbescherming. De afgelopen maand onthulde Anthropic dat drie Chinese AI-laboratoria – DeepSeek, Moonshot en MiniMax – 24.000 accounts hadden gebruikt om meer dan 16 miljoen uitwisselingen met Claude te genereren. waarbij de meest geavanceerde mogelijkheden worden geëxtraheerd via een techniek die destillatie wordt genoemd. De Chinese laboratoria hoefden niet in de toeleveringsketen te infiltreren of dure fabrieken te bouwen. Ze hadden alleen API-toegang en zorgvuldig opgestelde aanwijzingen nodig, gerouteerd via proxynetwerken die ontworpen waren om detectie te voorkomen. Er bestaat geen farmaceutisch equivalent voor deze repliceerbaarheid.

De laatste cruciale disanalogie is snelheid. De farmaceutische goedkeuringspijplijn gaat ervan uit dat een product jaren van gecontroleerde tests zal ondergaan voordat het het publiek bereikt. Maar AI-modellen evolueren op softwaretijdlijnen. De mogelijkheden verbeteren niet alleen door uitbreiding van de hardware, maar ook door software-updates, nieuwe trainingsmethoden en frequente modelreleases die betekenisvolle sprongen in weken in plaats van jaren kunnen opleveren. Anthropic verscheepte bijvoorbeeld binnen tien weken twee grote Claude-releases. De iteratiecyclus is zo snel dat tegen de tijd dat een goedkeuringsproces in farmaceutische stijl een model zou kunnen evalueren, dat model al achterhaald zou zijn – vervangen door iets veel krachtigers waarvoor het evaluatieproces nog niet eens was begonnen.

Waarom “testen, implementeren, monitoren” niet werkt

Het probleem beperkt zich niet tot de overheid. Hetzelfde farmaceutische denken dat de regelgevingskaders verstoort, heeft wortel geschoten in organisaties – en laat hen om dezelfde redenen blootstaan.

De risico’s van het farmaceutische type zijn bekend: een product kan schadelijke bijwerkingen hebben, dus u test het vóór implementatie, controleert het daarna en trekt het terug als er iets misgaat. Zelfs zonder externe toezichthouder passen veel bedrijven deze logica intern toe op kunstmatige intelligentie, waarbij ze risico’s beheersen via de bekende methoden van fase-gate reviews, pre-implementatietests en post-lanceringsmonitoring. Het voelt verantwoordelijk. Het voelt voldoende.

Dit is precies het gevaar.

Natuurlijk zijn fase-gate-beoordelingen en tests voorafgaand aan de implementatie niet waardeloos. Ze onderkennen echte fouten, dwingen discipline af en creëren een papieren spoor dat blijk geeft van due diligence tegenover besturen en toezichthouders. Elke organisatie die ze heeft geïmplementeerd, is beter af dan een organisatie die niets heeft gedaan. Maar deze frames creëren een vals gevoel van dekking. Het risico waarmee ze omgaan is het risico waarvoor ze zijn ontworpen: productfalen, nadelige effecten, fouten in de kwaliteitscontrole. Het risicoprofiel van AI heeft een heel andere vorm. Het wordt gedefinieerd door de mogelijkheid van onomkeerbaarheid, snelle verspreiding en misbruik. Niet alle door AI aangestuurde uitkomsten zullen deze risico’s met zich meebrengen. In tegenstelling tot een defect product kunt u echter geen terugroepactie starten nadat de schade is ontstaan.

Deze combinatie van potentiële bedreigingen betekent dat de bekende toolkit van risicobeheer eenvoudigweg niet past – en organisaties die denken dat dit wel het geval is, accepteren risico’s die ze niet in kaart hebben gebracht. Juist om deze uitdagingen het hoofd te bieden, hebben wij ontwikkeld De OPEN- en CARE-frameworks voor het beheren van AI-innovatie en -risico’s. Het CARE-framework biedt met name een gestructureerde aanpak voor het beheer van AI-risico’s en vormt de basis voor de aanbevelingen die volgen.

Bouw governance op voor AI-risico’s

Het CARE-framework kent vier fasen: rampen, waarbij wordt vastgesteld wat er mis kan gaan; Beoordeel en prioriteer deze risico’s; Reguleren, implementeren van controles; en Exit, plannen wanneer deze controles falen. Toegepast op de AI-blootstelling van uw organisatie, wijst het raamwerk op vijf onmiddellijke acties.

1. Breng uw schaduw-AI-blootstelling onder de aandacht. Stel uw directe ondergeschikten een vraag: welke AI-tools gebruikt u die niet door het bedrijf zijn geleverd? De antwoorden zullen u vertellen hoe groot het verschil is tussen de AI die uw organisatie officieel gebruikt en de AI waar uw medewerkers daadwerkelijk op vertrouwen.

2. Breng uw punten van onomkeerbaarheid in kaart – en uw terugvalpunten. Identificeer de AI-afhankelijke processen waarbij een storing onomkeerbaar of zeer schadelijk zou zijn, zoals geautomatiseerde klantcommunicatie, AI-ondersteunde code die naar productie wordt gepusht, algoritmische werkgelegenheid schermen. Vraag of uw huidige beveiligingsmaatregelen ervan uitgaan dat u bugs kunt opsporen en oplossen voordat ze de buitenwereld bereiken. Als dat het geval is, moet u ze opnieuw ontwerpen – en expliciete noodprocedures opstellen als ze toch falen.

3. Vergrendel uw gegevensblootstelling. Elke AI-tool waarmee uw organisatie in aanraking komt, is een datapijplijn die in beide richtingen loopt. Deel uw gegevens in in niveaus (openbaar, intern, vertrouwelijk, beperkt) en breng in kaart welke AI-tools voor elk niveau zijn goedgekeurd. Controleer uw leveranciersovereenkomsten op clausules over educatieve gegevens. Op het moment dat eigendomsgegevens een systeem van derden binnenkomen, is uw vermogen om deze te herinneren verdwenen.

4. Rode team voor misbruik, niet alleen voor een defect. Rode teams voor storingen vragen: “Wat als dit kapot gaat?” Red-teaming voor misbruik vraagt: “Wat als dit precies werkt zoals bedoeld en iemand het voor het verkeerde doel gebruikt?” Zoals de Catastrofize-fase van het CARE-framework benadrukt, heb je beide nodig.

5. Wijs duidelijk uitvoerend eigenaarschap toe. Geen van de bovenstaande zaken doet er toe als de verantwoording over commissies is verspreid. Benoem één enkele manager die het AI-risico draagt, aangezien uw CFO het financiële risico draagt. Deze persoon heeft autoriteit, budget en een directe lijn naar het bestuur nodig.

De juiste inzet

Regulering op drugsgebied is al tientallen jaren een van de meest succesvolle oplossingen in het bedrijfsleven: een raamwerk dat het publiek beschermt zonder de industrie te verstikken. Maar het model is onvoldoende voor kunstmatige intelligentie.

Op overheidsniveau zoeken serieuze mensen naar serieuze oplossingen. Sam Altman’s oproep voor de top in New Delhi een internationale regelgevende instantie naar het voorbeeld van de Internationale Organisatie voor Atoomenergie weerspiegelt een duidelijker beeld van wat voor soort technologie dit is – een technologie die monitoringkaders vereist die overeenkomen met het werkelijke risicoprofiel ervan, en geen modellen die zijn geleend van sectoren die de kenmerken ervan niet delen.

Bedrijfsleiders moeten hetzelfde pad volgen. De categorie problemen waarmee overheden op internationaal niveau worstelen, is dezelfde categorie problemen waarmee u in uw organisatie worstelt. Ontwerp uw bedieningselementen dienovereenkomstig: voor de technologie die u daadwerkelijk heeft, niet voor de technologie waarmee u te maken zou willen hebben.

{“blockType”:mv-promo-block”,”data”:{“imageDesktopUrl”:https://images.fastcompany.com/image/upload/f_webp,q_auto,c_fit/wp-cms-2/2025/10/creator-faisalhoq ue.png”,”imageMobileUrl”https://images.fastcompany.com/image/upload/f_webp,q_auto,c_fit/wp-cms-2/2025/10/faisal-hoque.png”eyebrow” “klaar” om te gedijen op het kruispunt van zakenleven, technologie en menselijkheid? “,”dek “De boeken, podcasts en bedrijven van Faisal Hoque bieden leiders het raamwerk en de platforms om doelen, mensen, processen en technologie op één lijn te brengen – waardoor disruptie wordt omgezet in betekenisvolle, duurzame vooruitgang.” Meer”,”ctaUrl”:https://faisalhoque.com”, “theme”:{“bg”:#02263c”, “text”:#ffffff”,”eyebrow”#9aa2aa”, subhed”#ffffff”, “buttonBg”:#ffffff”, “b uttonHoverBg”:#3b3f46″, “buttonText”:#000000″},”imageDesktopId”:91420512,”imageMobileId”:91420514,”deelbaar”:false,”slug””,”wpCssClasses””}

Nieuwsbron