- Micron introduceert een compacte LPDDR5x-module van 256 GB, rechtstreeks gericht op AI-servers

- Acht SOCAMM2-modules kunnen de geheugencapaciteit van de server opvoeren tot maar liefst 2TB

- Door AI geïnitieerde workloads verschuiven prestatieknelpunten steeds meer naar de systeemgeheugencapaciteit

Grote taalmodellen (LLM’s) en moderne inferentiepijplijnen vereisen steeds meer enorme geheugenpools, waardoor hardwareleveranciers gedwongen worden de servergeheugenarchitectuur te heroverwegen.

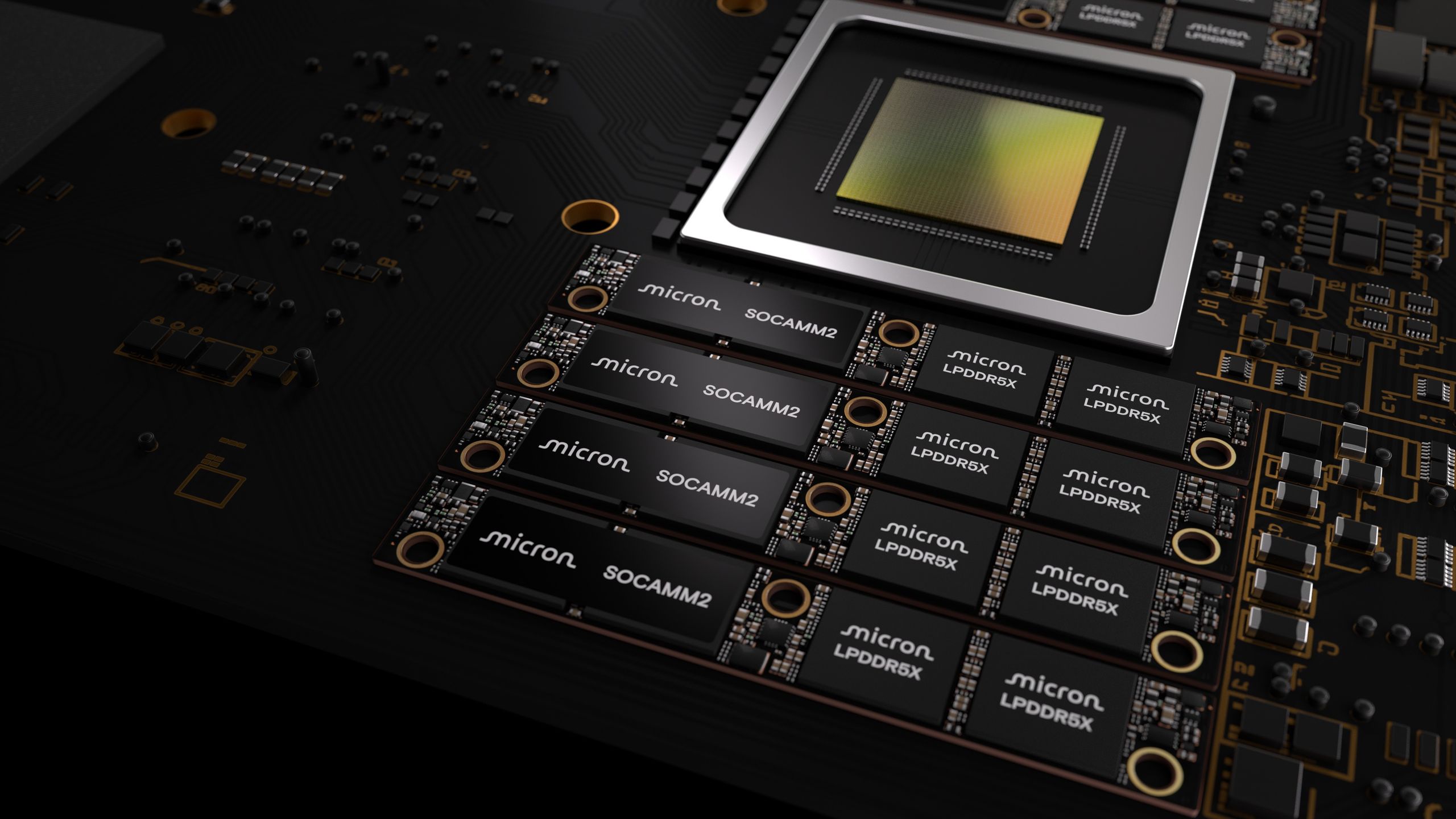

Micron heeft nu een SOCAMM2-geheugenmodule van 256 GB geïntroduceerd die is ontworpen voor datacentrum systemen waarbij capaciteit, bandbreedte en energie-efficiëntie allemaal van invloed zijn op de algehele prestaties.

De module is gebaseerd op 64 monolithische LPDDR5x-chips van 32 GB die een compact LPDRAM-pakket vormen dat tegemoetkomt aan de groeiende geheugenvoetafdruk die nodig is voor de huidige AI-workloads.

Het artikel gaat hieronder verder

Schaal van de geheugencapaciteit voor AI-serverplatforms

De module vergroot ook het maximaal beschikbare geheugen per processorconfiguratie. Wanneer acht van deze SOCAMM2-modules zijn geïnstalleerd in een achtkanaalsserver CPUde totale capaciteit kan 2TB LPDRAM bereiken.

Dit aantal overschrijdt de vorige modulegeneratie van 192 GB met ongeveer een derde, waardoor systemen grotere contextvensters en veeleisendere inferentietaken kunnen accommoderen.

Micron beschrijft het SOCAMM2-ontwerp als efficiënter dan conventionele servergeheugenmodules.

“Micron’s 256GB SOCAMM2-aanbod maakt de meest energiezuinige CPU-gekoppelde geheugenoplossing mogelijk voor zowel AI als HPC”, zegt Raj Narasimhan, senior vice-president en algemeen manager van Micron’s Cloud Memory Business Unit.

“Ons voortdurende leiderschap op het gebied van energiezuinige geheugenoplossingen voor datacentertoepassingen heeft ons in een unieke positie geplaatst om de eerste te zijn die een 32Gb monolithische LPDRAM-chip levert, waardoor de acceptatie door de industrie van energiezuinigere systeemarchitecturen met hoge capaciteit wordt gestimuleerd.”

Het bedrijf zegt de nieuwe LPDRAM-module gebruikt ongeveer een derde van de kracht van vergelijkbare RDIMM’s, terwijl hij slechts een derde van de fysieke voetafdruk in beslag neemt.

De lagere stroomvereisten en de kleinere modulegrootte maken een hogere rackdichtheid mogelijk in grote datacenterinstallaties, terwijl het lagere geheugenvermogen de thermische belasting en infrastructuurkosten verlaagt.

De SOCAMM2-architectuur volgt ook een modulair ontwerp dat bedoeld is om onderhoud en toekomstige uitbreiding te vereenvoudigen.

Het formaat ondersteunt vloeistofgekoelde serversystemen en kan extra capaciteit bieden naarmate de geheugenvereisten toenemen naarmate de modelcomplexiteit en de schaal van de dataset toenemen.

Micron zegt dat de SOCAMM2-module van 256 GB bepaalde inferentiebewerkingen onder uniforme geheugenarchitecturen kan beïnvloeden.

Het bedrijf rapporteert een meer dan 2,3x verbetering in de tijd tot het eerste token tijdens lange context-inferentie wanneer de module wordt gebruikt voor het lezen van sleutelwaarde-cache.

Bij standalone CPU-workloads levert de LPDRAM-configuratie naar verluidt meer dan 3x betere prestaties per watt vergeleken met reguliere servergeheugenmodules.

Het LPDRAM-portfolio van het bedrijf omvat componenten van 8 GB tot 64 GB en SOCAM2-modules variërend van 48 GB tot 256 GB, en klantenmonsters van de 256 GB SOCAMM2-module zijn al verzonden.

Volg TechRadar op Google Nieuws En voeg ons toe als voorkeursbron om ons deskundig nieuws, recensies en meningen in uw feeds te krijgen. Klik dan zeker op de knop Volgen!

En jij kunt dat natuurlijk ook Volg TechRadar op TikTok voor nieuws, recensies, video-unboxings en ontvang regelmatig updates van ons WhatsAppen Ook.