Datateams die AI-agenten bouwen, komen steeds in dezelfde foutmodus terecht. Vragen die vereisen dat gestructureerde gegevens worden samengevoegd met ongestructureerde inhoud, verkoopcijfers met klantrecensies of citatietellingen met academische artikelen, breken single-turn RAG-systemen.

Nieuw onderzoek van Databricks geeft een cijfer aan deze foutenkloof. Het AI-onderzoeksteam van het bedrijf testte een meerfasige agentaanpak tegen geavanceerde single-turn RAG-basislijnen voor negen zakelijke kennistaken en rapporteerde winsten van 20% of meer op Stanfords STaRK-benchmarksuite, samen met consistente verbeteringen in Databricks eigen KARLBench-evaluatiekadervolgens de enquête. Databricks stelt dat de prestatiekloof tussen single-turn RAG en multi-step agents bij hybride datataken een architectonisch probleem is, en geen modelkwaliteitsprobleem.

Het werk bouwt voort op het eerdere werk van Databricks geïnstrueerde retriever onderzoek dat verbeteringen aantoonde in het ophalen van ongestructureerde gegevens met behulp van metadata-bewuste queries. Dit nieuwste onderzoek voegt gestructureerde gegevensbronnen, relationele tabellen en SQL-opslagplaatsen toe aan dezelfde redeneringslus, en richt zich op de categorie vragen die bedrijven met de huidige agent-architecturen vaak niet kunnen beantwoorden.

“RAG werkt, maar schaalt niet”, zegt Michael Bendersky, onderzoeksdirecteur bij Databricks, tegen VentureBeat. “Als je je agent nog beter wilt maken en wilt begrijpen waarom je omzet daalt, moet je de agent nu helpen de tabellen te zien en de verkoopgegevens te bekijken. Je RAG-pijplijn wordt incompetent voor die taak.”

Ophalen in één beurt kan geen structurele beperkingen coderen

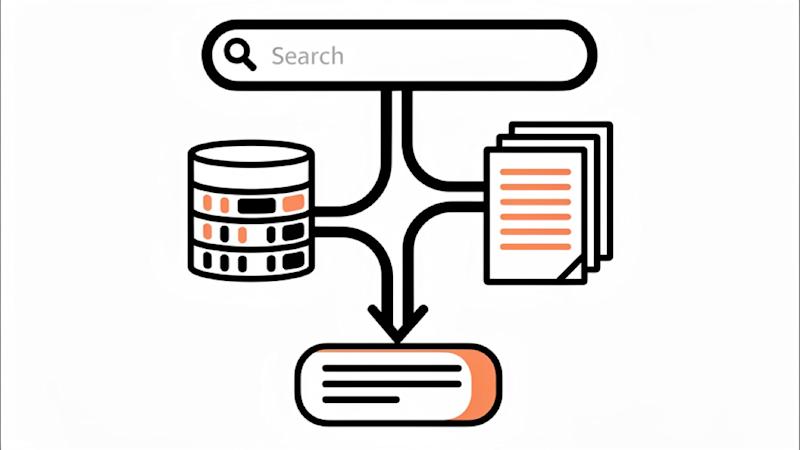

Het kernresultaat is dat standaard RAG-systemen falen wanneer een zoekopdracht een nauwkeurig gestructureerd filter combineert met een open semantische zoekopdracht.

Denk eens aan een vraag als ‘Van welke van onze producten is de verkoop de afgelopen drie maanden afgenomen, en welke mogelijk gerelateerde problemen zijn naar voren gekomen in klantrecensies op verschillende websites van verkopers?’ De verkoopgegevens bevinden zich in een magazijn. Het recensie-sentiment leeft in ongestructureerde documenten op verkoperssites. Een single-turn RAG-systeem kan deze zoekopdracht niet splitsen, elke helft naar de juiste gegevensbron leiden en de resultaten combineren.

Om te bevestigen dat dit eerder een architectuurprobleem is dan een modelkwaliteitsprobleem, heeft Databricks de gepubliceerde STaRK-basislijnen opnieuw uitgebracht met behulp van een huidig state-of-the-art basismodel. Het sterkere model verloor volgens het onderzoek nog steeds van de meerstapsagent met 21% in het academische domein en 38% in het biomedische domein.

STaRK is een benchmark gepubliceerd door Stanford-onderzoekers die drie semi-gestructureerde retrievaldomeinen bestrijkt: Amazon-productgegevens, Microsoft Academic Graph en een biomedische kennisbank.

Hoe Supervisor Agent omgaat met wat RAG niet kan

Databricks heeft de Supervisor Agent gebouwd als productie-implementatie van deze onderzoeksaanpak, en de architectuur ervan illustreert waarom de winsten consistent zijn voor alle taaktypen. De aanpak omvat drie kernstappen:

Parallelle gereedschapsdegradatie. In plaats van één brede zoekopdracht te geven en te hopen dat de resultaten zowel gestructureerde als ongestructureerde behoeften dekken, vuurt de agent tegelijkertijd SQL- en vectorzoekopdrachten af en analyseert vervolgens de gecombineerde resultaten voordat hij besluit wat hij moet doen. De parallelle stap maakt het mogelijk om query’s af te handelen die de grenzen van het gegevenstype overschrijden zonder dat de gegevens eerst moeten worden genormaliseerd.

Zelfcorrectie. Wanneer een eerste ophaalpoging op een doodlopende weg stuit, ontdekt de agent de fout, herformuleert de zoekopdracht en probeert een ander pad. Bij een STaRK-benchmarktaak waarbij een artikel moet worden gevonden van een auteur met precies 115 eerdere publicaties over een specifiek onderwerp, voert de agent eerst parallelle query’s uit op zowel SQL- als vectorzoekopdrachten. Wanneer de twee resultatensets geen overlap vertonen, past het zich aan en geeft het een SQL JOIN uit over beide beperkingen, waarna het vectorzoeksysteem wordt aangeroepen om het resultaat te verifiëren voordat het antwoord wordt geretourneerd.

Declaratieve configuratie. De agent is niet afgestemd op een bepaalde dataset of taak. Als u deze aan een nieuwe gegevensbron koppelt, betekent dit dat u in duidelijke taal een beschrijving schrijft van wat die bron bevat en welke soorten vragen deze moet beantwoorden. Geen aangepaste code vereist.

“De agent kan dingen doen zoals de vraag ontleden in een SQL-query en een kant-en-klare zoekopdracht”, aldus Bendersky. “Het kan de resultaten van SQL en RAG combineren, over die resultaten redeneren, vervolgvragen stellen en vervolgens redeneren of het definitieve antwoord daadwerkelijk is gevonden.”

Het gaat niet alleen om hybride pick-up

Het Databricks-onderscheid gaat niet over de ophaaltechniek, maar over de architectuur.

“We zien het nauwelijks als een hybride opzoeking waarbij je insluitingen en zoekresultaten of insluitingen en tabellen combineert”, zei hij. “We zien dit meer als een agent die toegang heeft tot meer tools.”

Het praktische gevolg van deze framing is dat het toevoegen van een nieuwe gegevensbron betekent dat deze aan de agent moet worden gekoppeld en dat er een beschrijving moet worden geschreven van wat deze bevat. De agent handelt routering en orkestratie af zonder aanvullende code.

Aangepaste RAG-pijplijnen vereisen dat gegevens worden geconverteerd naar een indeling die het ophaalsysteem kan lezen, meestal stukjes tekst met insluitingen. SQL-tabellen moeten worden afgevlakt, JSON moet worden genormaliseerd. Elke nieuwe gegevensbron die aan de pijplijn wordt toegevoegd, betekent meer conversiewerk. Uit het onderzoek van Databricks wordt beargumenteerd dat naarmate bedrijfsdata meerdere brontypen gaan omvatten, deze last aangepaste pipelines steeds onpraktischer maakt vergeleken met een agent die elke bron in zijn oorspronkelijke formaat bevraagt.

“Breng de agent gewoon naar de gegevens”, zei Bendersky. “Je geeft de agent feitelijk meer bronnen en hij zal ze redelijk goed leren gebruiken.”

Wat het betekent voor bedrijven

Voor data-ingenieurs die overwegen of ze aangepaste RAG-pijplijnen moeten bouwen of een declaratief agent-framework moeten adopteren, biedt het onderzoek een duidelijke richting: als de taak vragen omvat die gestructureerde en ongestructureerde gegevens omvatten, is het bouwen van aangepaste retrieval het moeilijkere pad. Uit het onderzoek bleek dat bij alle geteste taken de enige dingen die verschilden tussen de implementaties de instructies en gereedschapsbeschrijvingen waren. De agent deed de rest.

De praktische grenzen zijn reëel, maar beheersbaar. De aanpak werkt goed met vijf tot tien gegevensbronnen. Als u er te veel tegelijk toevoegt, zonder te bepalen welke bronnen complementair zijn in plaats van conflicterend, wordt de agent langzamer en minder betrouwbaar. Bendersky raadt aan om stapsgewijs te schalen en de resultaten bij elke stap te verifiëren, in plaats van alle beschikbare gegevens vooraf met elkaar te verbinden.

Accuratesse van data is een voorwaarde. De agent kan query’s uitvoeren in verschillende formaten, JSON-beoordelingsfeeds en SQL-verkooptabellen zonder dat normalisatie nodig is. Het kan geen brongegevens corrigeren die feitelijk onjuist zijn. Door tijdens het laden een duidelijke beschrijving van elke gegevensbron toe te voegen, kan de agent zoekopdrachten vanaf het begin correct routeren.

Het onderzoek plaatst dit als een eerste stap in een langer traject. Naarmate de AI-workloads van ondernemingen volwassener worden, wordt van agenten verwacht dat ze met tientallen brontypen kunnen redeneren, waaronder dashboards, codeopslagplaatsen en externe datafeeds. Het onderzoek betoogt dat het de declaratieve benadering is die deze schaalvergroting betaalbaar maakt, omdat het toevoegen van een nieuwe bron eerder een configuratieprobleem dan een technisch probleem blijft.

“Dit lijkt een beetje op een ladder”, zei Bendersky. “De agent zal langzaam steeds meer informatie verkrijgen en vervolgens langzaam in het algemeen verbeteren.”