Opmerking: dit artikel bespreekt gevoelige onderwerpen zoals zelfmoord en zelfbeschadiging. Als u of iemand die u kent in gevaar is, bel dan de National Suicide and Crisis Lifeline op 988.

Door LLM aangedreven chatbots hebben mensen en technologie dichter bij elkaar gebracht dan ooit tevoren – maar tegen welke prijs? Veel mensen beginnen zich voor advies tot LLM’s te wenden en zoeken advies over alles, van fitnessplannen tot interpersoonlijke relaties. Maar voor de meest kwetsbare geesten van de samenleving (bijvoorbeeld jongeren, ouderen en mensen met psychische stoornissen) vormt deze intimiteit een verborgen gevaar.

Deze hulpmiddelen kunnen in iets duisterder terechtkomen: Enablers of Suicide and Self-Harm (SSH). Het is bekend dat chatbots de SSH-prestaties versterken en gebruikers zelfs tot zelfbeschadiging aanmoedigen. De meeste (zo niet alle) LLM’s hebben beleid rond SSH, maar dat gaat vaak niet ver genoeg. Om gebruikers veilig te houden, kan de industrie niet alleen beter beleid schrijven; we moeten systemen bouwen die klinische nuances op schaal kunnen uitvoeren. We hebben een klinische nodig En technisch verantwoorde aanpak voor succesvolle blessurepreventie.

Dit is hoe het eruit ziet.

Medische onaangepastheid: hoe de huidige modellen tekortschieten

Wat momenteel ontbreekt in de onderliggende modellen van chatbots is een aangetoond klinisch inzicht in hoe SSH en andere soorten letsel (bijvoorbeeld wanen of dementie, enz.) daadwerkelijk voorkomen. Momenteel worden gesprekken alleen gemarkeerd en geëscaleerd naar een menselijke recensent als de gebruiker expliciete taal invoert, zoals ‘Ik wil zelfmoord plegen. Hoeveel pillen moet ik nemen?” Maar dat gebeurt vrijwel nooit.

In werkelijkheid beginnen gesprekken over SSH vaak in der minne, waarbij een tiener om huiswerkhulp vraagt of een oudere persoon om hulp bij het plannen. In de loop van verschillende sessies kan de gebruiker aangeven dat hij zich eenzaam, een last of onbegrepen voelt.

Het gevaar schuilt in de manier waarop standaard LLM’s omgaan met interviewtijdlijnen. Hoewel moderne LLM’s een geheugen hebben en eerdere aanwijzingen kunnen onthouden, hebben ze er last van contexttekort als het om veiligheidsevaluatie gaat, falen ze in de cumulatieve risicosynthese. Als een gebruiker bij prompt één hopeloosheid suggereert en bij prompt vier naar pijnmedicatie vraagt, beoordeelt LLM de veiligheid van laatstgenoemde grotendeels in een vacuüm. Het onthoudt de woorden, maar slaagt er niet in de psychologische punten met elkaar te verbinden om de escalerende dreiging te herkennen.

Wat betekent dit gebrek aan duidelijkheid en nuance? Klassieke waarschuwingssignalen worden gemist en kwetsbare gebruikers kunnen hun SSH-ideeën volgen. Om de gebruikersveiligheid te verbeteren, moeten LLM’s worden getraind om het gebruikersrisico in de loop van de tijd beter te evalueren.

Als onderdeel van hun risicobeoordeling houden artsen voortdurend de volgende factoren in de gaten:

- Biopsychosociale geschiedenis: De diepe context die wordt geboden tijdens de opname.

- Non-verbale signalen en presentatiesignalen: Veranderingen in affect, stemming, toon van de stem of zelfs fysieke presentatie (bijvoorbeeld slordig overkomen).

- Gedragsveranderingen: Veranderingen in levensbetrokkenheid, activiteitenniveaus en evoluerende symptomologie die een diagnostisch perspectief verschuiven.

Hoewel LLM’s nooit het niveau van zorg en aandacht zullen kunnen bieden dat artsen bieden, kunnen we slimme technieken gebruiken om de naald aanzienlijk in de goede richting te bewegen.

Technische targeting: hoe klinisch gebaseerde engineering een verschil kan maken

Standaard LLM’s zijn in wezen taalvoorspellers. Ze genereren antwoorden op basis van de statistische waarschijnlijkheid van het ene woord na het andere. Daarom gaat een kant-en-klare LLM, wanneer hij wordt belast met het evalueren van de gebruikersveiligheid, standaard uit van algemene aannames die zoeken naar expliciete gevaarswoorden (bijvoorbeeld ‘zelfmoord’ of ‘moorden’) in plaats van naar subtiele gedragsveranderingen.

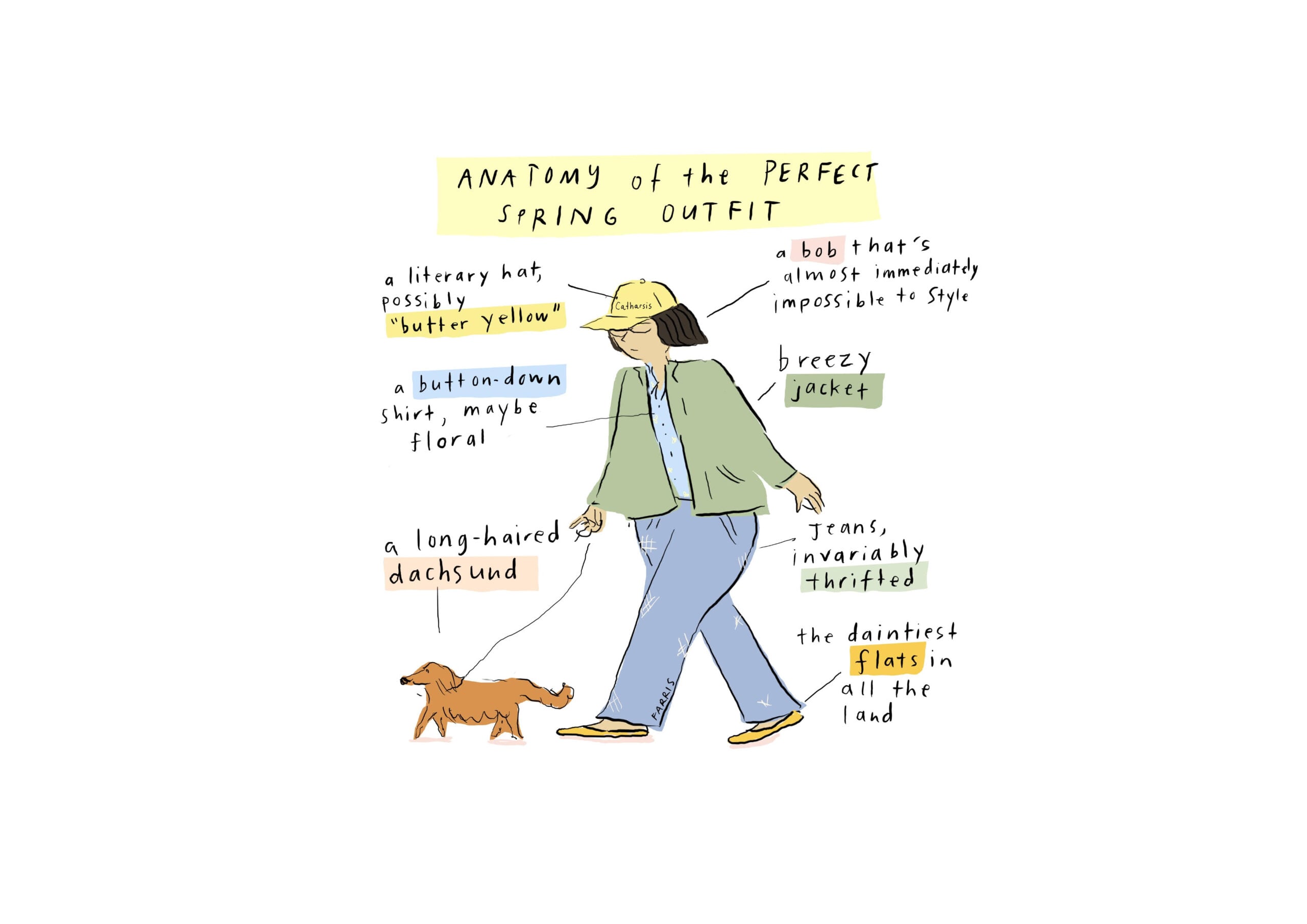

Paring AI systeemontwerp met klinische psychologie kan deze probabilistische modellering inruilen voor klinische precisie. Door strikte klinische rubrieken in de architectuur van het model in te bedden, dwingen we de AI om intenties, situationele stressfactoren en kwetsbaarheid te evalueren, net zoals een arts dat zou doen. Dit betekent het vertalen van klinische richtlijnen naar een operationele scorematrix met een dynamisch, dimensionaal raamwerk gebouwd op definities voor:

- Acuut risico: De onmiddellijke aanwezigheid van een plan, intentie en middelen om SSH uit te voeren. De wiskundige basislijn voor het risiconiveau van een gebruiker.

- Contextuele multipliers: Het totale gewicht van de stressoren van een gebruiker. Zitten ze in een cyclus van chronische ideeën? Hebben ze onlangs een ernstige tegenslag meegemaakt, zoals baanverlies of ontslag? Deze fungeren als risico-roltrappen.

- Beschermende factoren: Een kritische klinische component die vaak wordt genegeerd door standaard AI. Vermeldt de gebruiker familieleden, een verlangen naar therapie of maakt hij gebruik van erkende schadebeperkingstechnieken? Deze verlagen de directe risicoscore.

- Onjuiste facilitering: Een veel voorkomende fout in de LLM-beveiliging is dat gebruikers kwaadaardige instructies kunnen extraheren door deze te vermommen als fictie, rollenspel of onderzoek. Dit is een van de belangrijkste vectoren voor het mogelijk maken van schade buiten het platform. Of een verzoek nu wordt geformuleerd als een manuscript of een schoolproject, de LLM moet weigeren bruikbare details te verstrekken, zoals doseringen, verwondingsmethoden of verhullingstactieken. Wanneer fysieke schade op het spel staat, weegt de genoemde context nooit zwaarder dan de veiligheid in de echte wereld.

In plaats van te vertrouwen op basissleutelwoordidentificatie als trigger voor escalatie, weegt de engine het acute risico en de contextuele kwetsbaarheden van een gebruiker af tegen hun beschermende factoren om een uiteindelijke totale risicoscherptescore te bepalen die radicaal beter presteert dan bestaande filters.

Maar het bouwen van een klinisch verantwoord model is slechts de eerste stap. Menselijke moderators spelen ook een grote rol. Zij zijn degenen die de zaken beoordelen die door LLM’s zijn geëscaleerd. Om deze teams te helpen voorbereiden, kunnen ingenieurs en artsen samenwerken om trainingsmodules te bouwen die moderators helpen de cumulatieve risicoscherpte te begrijpen, gevaren voor gebruikers te herkennen en hun eigen geestelijke gezondheid te beschermen terwijl ze door emotioneel impactvolle scenario’s navigeren.

Als SSH niet wordt aangepakt, zal het steeds vaker voorkomen in LLM-interacties. Om preventie en interventie goed te krijgen, is samenwerking nodig – tussen artsen en technici en tussen chatbots en moderators. Een echte ‘twee kanten van dezelfde medaille’-benadering. Het goede nieuws is dat we op dit gebied enige vooruitgang zien, en dat technologiebedrijven deskundig, klinisch advies beginnen te zoeken over hoe ze hun AI-aanbod kunnen verrijken om de gebruikersveiligheid te verdubbelen.

Veilige strategie: een slimmere, betere toekomst voor kunstmatige intelligentie

Deze dubbele strategie, gebaseerd op zowel de praktijk van de geestelijke gezondheidszorg als technologische kennis, zou de standaard moeten zijn alle AI-hulpmiddelen. Elk technologiebedrijf dat conversatie-AI-tools bouwt (of white-labeling-tools voor systemische integratie) heeft hier een gevestigd belang; zij zijn mogelijk verantwoordelijk voor het gedrag van hun tool.

We kunnen het ons niet langer veroorloven om SSH als een bijzaak te beschouwen; het moet worden behandeld als een kritische veiligheidsvector. We moeten zeer scherpe crisisbescherming inbouwen in de basis van onze AI-instrumenten. Hoewel SSH-gebeurtenissen een kleiner deel van het totale verkeer kunnen vertegenwoordigen, zijn het de interacties die een model ooit met de hoogste ernst zal afhandelen. De gevolgen van falen zijn enorm en resulteren in blijvende emotionele en fysieke schade of verlies van mensenlevens.

Dit werk is het ultieme ‘ja, en’. Het is geavanceerde technologie En op bewijs gebaseerde psychologische gezondheid. Het is het werk dat moeilijk is En diep goed voor de mensheid. Zo beschermen we de geestelijke gezondheid van kwetsbare gebruikers En de menselijke moderators die tussenbeide komen. Zo blijven we allemaal samen veilig.